我们提供 摘录这是通过生成和使用自然背景故事的单个价值观和经验的详细信息来使LLM适应虚拟,一致和多样化的虚拟字符的方法。

LLMS模型是在一家庞大的文本公司中培训的,这是什么意思,该公司是由数百万杰出的人类作家生产的?

在“语言模型作为工人的模型”中,令人信服的证据表明,现代语言模型可以视为 代理商:提供了文本上下文,LLMS能够生成有条件的文本,代表工人的特征可能会产生此上下文。这表明,通过适当的空调,可以指示LLMS提出特定的人类音频,而不是 混合物 以其他方式显示。如果您意识到,这种LLMS能力将对用户和社会科学产生重大影响 – 空气条件的语言模型,例如 虚拟人物 人类主题可能是昂贵的实验研究,并支持人类研究中的最佳实践,例如正义和利益原则。

在这项工作中,我们提供 摘录,通过为个人作为空调的背景为个人提供丰富的详细生活小说,将LLMS引向虚拟,一致和多样化的虚拟人物的方法。

通过这样做,我们还提供了产生LLM的后站本身的方法,以此作为一种涵盖广泛人口组成的大型群体的方式。通过在自然背景故事中提供语言模型,LLMS津贴允许以诚意增加的单个人类样本模拟,以匹配分布和人类反应的一致性来衡量。

我们的方法: 摘录

生成适应个人生活小说的语言

对以前将LLM的方法引导到虚拟人物无法紧密脱离的方法有很大的限制 个人 人类样品。以前的方法推动LLM带有广泛的人口统计信息,例如:“我已经二十岁了,从加利福尼亚才有。通过这些方法,我们只能使人类样本更接近一个 人口水平,不是在个人层面上,这导致:

- 从刻板印象和/或典型的响应中,对LLM的反应仅以人口统计学变量为条件(例如种族和性别)

- 无法提供重要的重要性措施,例如对比和统计重要性,因为此类安装需要单个响应

选集允许通过空调和丰富的详细后站来带来单个主题。通过这些背景故事,该模型探讨了个人身份的隐性和明确迹象,包括人口特征和自发提及文化,社会,经济背景和生活哲学。我们的方法包括生成各种各样的背景故事,这些故事通过语言模型来代表着广泛的人口统计特征,而语言模型则以无限制和开放的主张进行询问,例如“告诉我关于您自己”。然后,我们将每个背景故事的条件虚拟字符与现实世界扫描的样本相匹配。

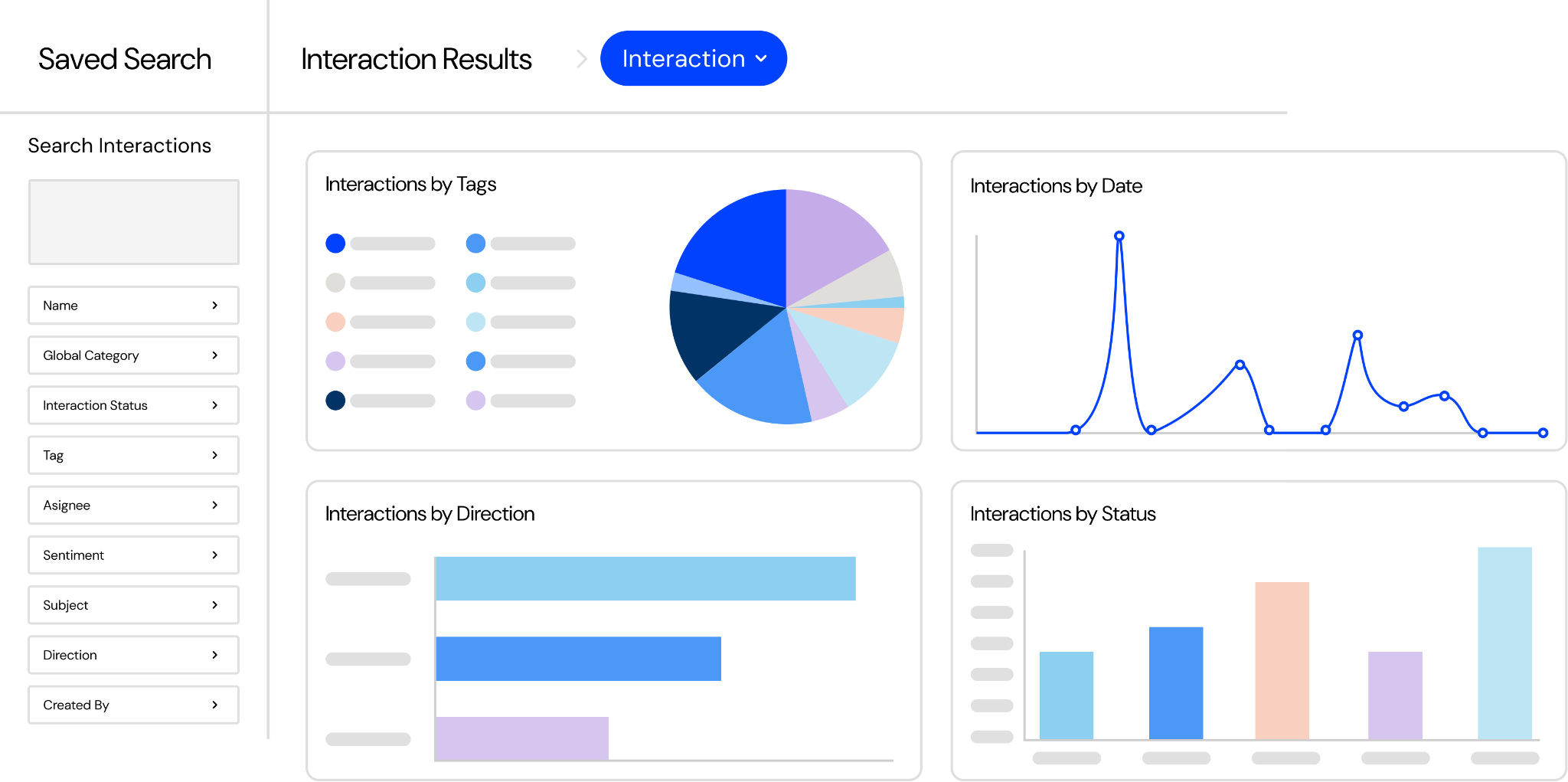

结果:几乎用于民意调查

为了进行评估,我们比较了在将三个ATP调查带到皮尤研究中心的不同方法的不同方法的有效性:WAVES 34、92和99。

结果为人类对Pew ATP研究中心的反应。大胆及其下方的结果分别表明最接近的值和第二位于人类中的值。

作为成功使人类样本更接近虚拟人物的标准,我们考虑以下标准:

- 响应分布之间的瓦斯汀(WD)距离的平均距离

- 相关性相关性之间的Frobenius Norm(FRO)

- alpha cronbach是内部一致性的附加措施

在分析虚拟主题之前,我们通过将人口划分为两个随机平等的群体并在子组之间计算这些标准来感谢每个评估量表的最小限制。我们从100次重复中获得平均值,以表示低估计值。

我们经常注意到这一点 摘录 对于Llama-3-70B和Mixral-8x22b,其他空调方法的表现都超过了所有标准。在比较两种匹配方法时,贪婪的匹配方法倾向于在所有波浪的平均瓦斯汀距离上显示出更好的性能。我们将匹配对应状态与最大匹配权重和有限数量的可见用户相匹配的方式的差异归因于差异。具体而言,指定为表观主题的权重不可避免地比贪婪匹配的权重少,因为后者休息在单个对应关系上。与贪婪的匹配相比,这种矛盾可能导致人类和相应的人类用户之间的人口相似性较低。这些结果表明,与基础线相比,我们方法中产生的后故事的丰富性提高了更准确的响应。

最终想法

选集是LLMS虚拟人员空调的一个新方向,可以通过为传统的人类调查提供发展性道德替代方案,有时是为了重塑用户研究,公众舆论调查和其他社会科学应用程序的方式。但是,通过选集的使用,就像在社会科学中的任何其他语言模型中一样,在引言中也带来了一些注意事项:尽管后面的故事创造了有助于创建更多代表性角色的帮助,但仍然存在维持偏见或侵犯隐私的风险,因此应谨慎使用和解释结果。

关于未来的步骤,我们认为我们的方法受益于更扩展和多样化的后验故事,每个故事都代表了个人的固定叙述。此外,这项工作的有价值的扩展是考虑自由响应的产生,这允许有组织的测量格式(例如多选项选择)之间进行更自然和准确的模拟。最后,行为研究中LLMS应用程序中的下一个令人兴奋的维度可能包括长期效果,使虚拟人员能够对更改进行建模并随着时间的流逝进行追溯检查。

所有这些趋势都带来了许多技术挑战。如果您有兴趣合作或想更多地讨论我们的工作,请告知我们!

了解有关我们工作的更多信息:完整纸的链接

@article{moon2024virtual,

title={Virtual personas for language models via an anthology of backstories},

author={Moon, Suhong and Abdulhai, Marwa and Kang, Minwoo and Suh, Joseph and Soedarmadji, Widyadewi and Behar, Eran Kohen and Chan, David M},

journal={arXiv preprint arXiv:2407.06576},

year={2024}

}